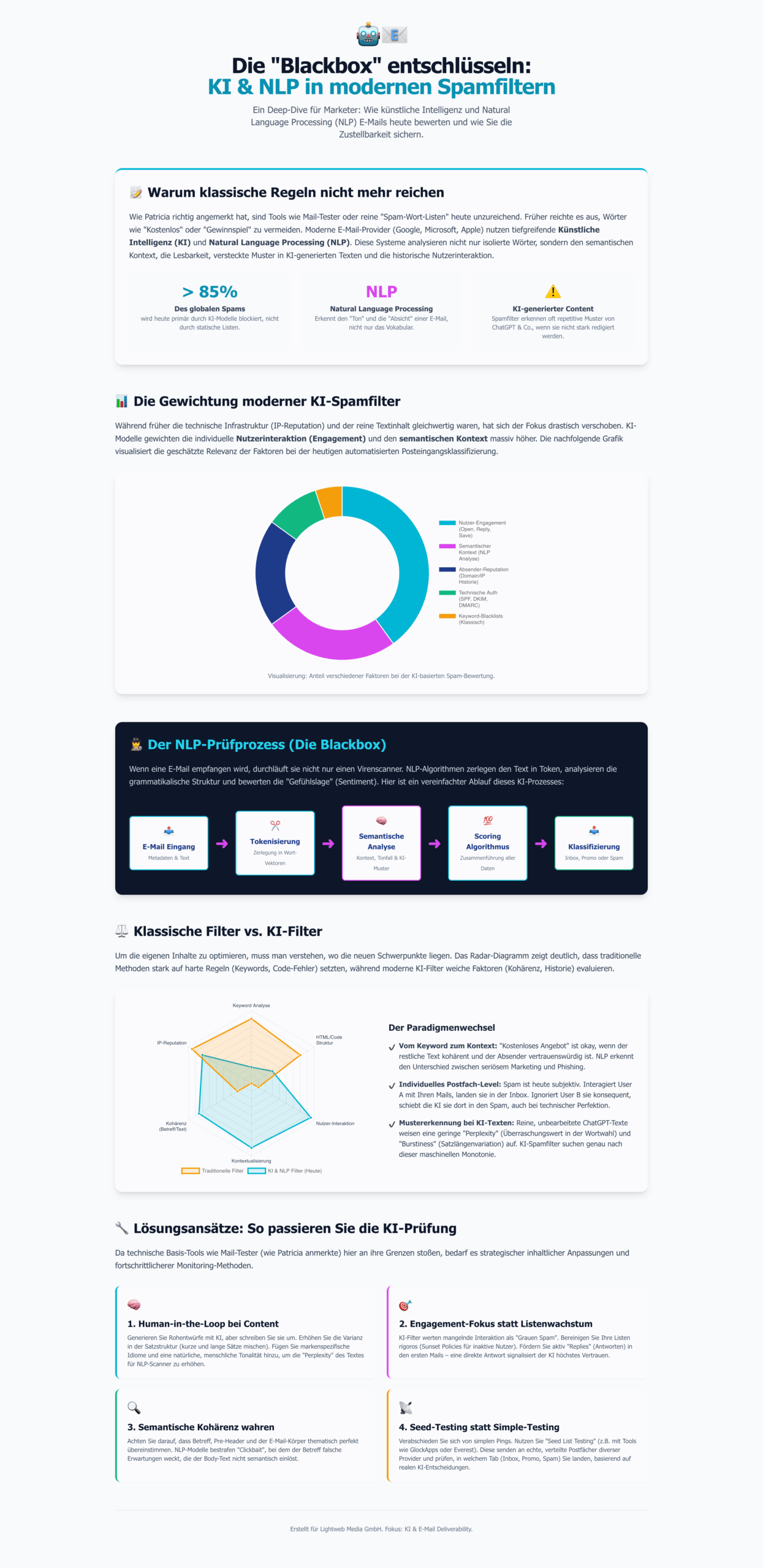

Neuronale Klassifizierung, linguistische Detektion und strategische Optimierung synthetischer Inhalte

Die digitale Kommunikation befindet sich in einer Ära der fundamentalen Neugestaltung, in der die Grenzen zwischen menschlicher Urheberschaft und algorithmischer Generierung zunehmend verschwimmen. Diese Transformation hat die Mechanismen der E-Mail-Filterung – einst einfache Wächter gegen plumpe Werbenachrichten – in hochkomplexe, auf neuronalen Netzwerken basierende Systeme verwandelt, die in der Lage sind, semantische Nuancen, intentionale Strukturen und sogar die mathematischen Fingerabdrücke von Sprachmodellen zu identifizieren.

Der Übergang von der heuristischen Analyse hin zur tiefen linguistischen Dechiffrierung markiert einen Wendepunkt, an dem die Zustellbarkeit einer Nachricht nicht mehr allein von ihrer technischen Konformität, sondern von ihrer statistischen Authentizität abhängt.

Die vorliegende Analyse untersucht die technologische Architektur moderner Spam-Filter, die Anwendung von Natural Language Processing (NLP) zur Inhaltsklassifizierung und die strategischen Methoden zur Optimierung von KI-generierten Inhalten, um eine nahtlose Posteingangsplatzierung in einer durch künstliche Intelligenz geprägten Verteidigungslandschaft zu gewährleisten.

Die Architektur der neuronalen Inhaltsklassifizierung

Die moderne E-Mail-Filterung bei führenden Providern wie Google und Microsoft basiert heute auf einer mehrschichtigen Hierarchie von Machine-Learning-Modellen, die weit über den bloßen Abgleich von Schlüsselwörtern hinausgehen.

Während Systeme der 1990er Jahre noch auf statischen Regeln basierten – etwa dem Filtern des Wortes „Gewinn“ -, nutzen heutige Architekturen die transformative Kraft von Large Language Models (LLMs), um die tieferliegende Absicht einer Nachricht zu verstehen.

Diese Entwicklung wurde durch die Notwendigkeit vorangetrieben, raffinierte Angriffe wie Business Email Compromise (BEC) zu bekämpfen, bei denen oft keine offensichtlich bösartigen Links oder Anhänge verwendet werden, sondern rein psychologische Manipulation.

Die Rolle von Transformer-Modellen und BERT

Im Zentrum der modernen Verteidigung stehen Transformer-Modelle, insbesondere BERT (Bidirectional Encoder Representations from Transformers), die eine bidirektionale Analyse des Textes ermöglichen.

Im Gegensatz zu älteren, rekurrenten neuronalen Netzen (RNNs), die Text sequenziell verarbeiteten, erlaubt die Self-Attention-Mechanik der Transformer-Modelle, die Relevanz jedes Wortes im Verhältnis zu jedem anderen Wort im gesamten Kontext der E-Mail zu bewerten.

Ein Transformer-basierter Filter erkennt somit nicht nur das Wort „Anmeldung“, sondern differenziert präzise zwischen einer legitimen Systembenachrichtigung und einer unter hohem Druck verfassten Phishing-Nachricht, die den Nutzer zur Preisgabe von Anmeldedaten drängt.

Diese Modelle werden kontinuierlich auf riesigen Datensätzen trainiert, die sowohl legitime Kommunikation als auch bekannte Bedrohungsmuster enthalten, wodurch sie eine bemerkenswerte Generalisierungsfähigkeit über verschiedene Sprachen und Domänen hinweg entwickeln.

RETVec: Resiliente Textvektorisierung bei Google

Ein signifikanter technologischer Durchbruch in der Bekämpfung von Inhaltsmanipulationen ist Googles Resilient & Efficient Text Vectorizer (RETVec), der 2023 eingeführt und seitdem als Standard in Gmail etabliert wurde.

RETVec adressiert eine klassische Schwachstelle von Filtern: die Anfälligkeit gegenüber absichtlichen Tippfehlern, Homoglyphen (z. B. „G00gle“ oder „Gmаil“ mit kyrillischem „а“) und der Verwendung von Sonderzeichen zur Verschleierung von Begriffen.

Die technische Architektur von RETVec ist darauf ausgelegt, Text als visuelles Muster zu interpretieren, ähnlich wie es das menschliche Auge tut. Dies wird durch einen zweistufigen Prozess erreicht: den Integerizer und den Binarizer.

Komponentenübersicht

| Komponente | Beschreibung | Spezifikationen |

|---|---|---|

| Integerizer-Schicht | Konvertiert Eingabezeichen in ihre entsprechenden UTF-8-Codepunkte | Unterstützt alle validen UTF-8-Zeichen |

| Binarizer-Schicht | Wandelt Integer-Codepunkte in eine 24-Bit-Binärdarstellung (Little-Endian) um | Kompakte Darstellung zur Reduzierung des Speicherbedarfs |

| Einbettungsmodell | Ein neuronales Netz mit ca. 230k Parametern zur Erzeugung von Wortvektoren | Erzeugt 256-dimensionale syntaktische Metrik-Einbettungen |

RETVec nutzt paarweises metrisches Lernen (Pair-wise Metric Learning), wobei das Modell darauf trainiert wird, Wörter mit typografischen Fehlern im Vektorraum nahe an ihre korrekten Gegenstücke zu rücken.

Durch die Verwendung der Multi-Similarity Loss Funktion wird sichergestellt, dass selbst komplexe Manipulationen wie „L33t-Speak“ oder eingefügte unsichtbare Zeichen die Klassifizierung nicht täuschen können.

In der Praxis führte dies zu einer Verbesserung der Spam-Erkennungsrate um 38 % bei gleichzeitiger Reduzierung der falsch-positiven Ergebnisse um 19,4 %, während die Rechenlast auf TPUs (Tensor Processing Units) um 83 % sank.

Heuristische Signale und Verhaltenskorrelation

Trotz der Dominanz von NLP-Modellen bleiben heuristische Signale ein integraler Bestandteil der Filter-Ecosysteme. Die KI korreliert Textanalysen mit Infrastrukturdaten und Nutzerverhalten.

| Signalkategorie | Datenpunkte | Auswirkung auf die Klassifizierung |

|---|---|---|

| Infrastruktur | IP-Reputation, Domain-Alter, SPF/DKIM/DMARC-Status | Fundamentale Vertrauensprüfung vor der Inhaltsanalyse |

| Verhalten | Öffnungsraten, Antwortzeit, Klickverhalten, Löschrate | Anpassung des Filters an individuelle Nutzerpräferenzen |

| Nachrichtentyp | Bild-zu-Text-Verhältnis, Link-Struktur, Anhangstypen (z. B. SVG) | Erkennung von Verschleierungstaktiken wie Bild-Spam oder bösartigen Skripten |

Moderne Systeme wie Microsoft Defender für Office 365 nutzen diese Korrelationen, um Kampagnen zu identifizieren, die KI-generierten Code in SVG-Dateien verwenden, um traditionelle sandboxing-basierte Verteidigungen zu umgehen.

Die KI erkennt hierbei Muster, die für menschliche Programmierer untypisch sind, etwa eine extreme Redundanz oder eine unnatürliche Komplexität des Codes.

Die statistische Natur der KI-Text-Detektion

Mit der Verbreitung von generativer KI ist die Identifizierung von maschinell erstellten Texten zu einer zentralen Aufgabe für Spam-Filter geworden.

Die Detektion basiert primär auf der Beobachtung, dass Sprachmodelle Texte nach statistischen Wahrscheinlichkeiten generieren, was zu Mustern führt, die sich signifikant von der menschlichen Kreativität und Varianz unterscheiden.

Perplexity: Das Maß der Vorhersehbarkeit

Ein grundlegendes Konzept in der Detektion ist die Perplexity, welche die „Überraschung“ eines Modells angesichts einer Wortsequenz misst.

Ein Text mit niedriger Perplexity ist für ein Sprachmodell hochgradig vorhersehbar, da er den statistisch wahrscheinlichsten Pfaden folgt.

KI-Modelle wie GPT-4 oder Claude tendieren dazu, „sichere“ Wortwahlen zu treffen, was zu einer gleichförmigen, glatten Textstruktur führt.

Menschliches Schreiben hingegen weist oft plötzliche Spitzen in der Perplexity auf, wenn Autoren ungewöhnliche Metaphern, seltene Vokabeln oder spezifische fachliche Fachbegriffe verwenden, die statistisch weniger wahrscheinlich sind.

Burstiness: Die Dynamik der Satzstruktur

Während Perplexity die Vorhersehbarkeit auf Wortebene misst, bezieht sich Burstiness auf die Varianz in der Satzlänge und -struktur über ein gesamtes Dokument hinweg.

Menschliche Kommunikation ist von Natur aus „stoßweise“ (bursty): Einem langen, erklärenden Satz folgt oft ein kurzer, prägnanter Einwurf.

KI-Modelle erzeugen hingegen oft Texte mit einer sehr uniformen Rhythmik, bei der die Sätze eine ähnliche Länge und eine stereotype Subjekt-Verb-Objekt-Struktur aufweisen.

| Merkmal | KI-generierter Text | Menschlicher Text |

|---|---|---|

| Satzlängenvarianz | Gering (gleichmäßig) | Hoch (rhythmische Wechsel) |

| Strukturelle Muster | Repetitiv, formell korrekt | Kreativ, teils unkonventionell |

| Sprachrhythmus | Monoton, „ein-notig“ | Dynamisch, wechselhaft |

Studien haben gezeigt, dass die Kombination dieser beiden Metriken es Detektoren ermöglicht, KI-Inhalte mit einer Genauigkeit von über 90 % zu identifizieren, sofern der Text eine gewisse Mindestlänge überschreitet.

In der E-Mail-Filterung führt ein niedriger kombinierter Score oft zu einer tieferen Prüfung oder einer direkten Klassifizierung als „Promotions“ oder „Spam“, da die Nachricht als unpersönliche Massenkommunikation eingestuft wird.

Strategien zur Optimierung von KI-Inhalten für die Zustellbarkeit

Um die durch NLP-Modelle und statistische Detektoren errichteten Barrieren zu überwinden, müssen Ersteller von KI-Inhalten Ansätze wählen, welche die authentische menschliche Varianz simulieren oder die Inhaltsprüfung durch technische Exzellenz entwerten.

Die Optimierung erfolgt auf drei Ebenen:

- linguistische Diversifizierung

- strategisches Prompt-Engineering

- technisches Reputationsmanagement

Linguistische Diversifizierung und „Humanisierung“

Die effektivste Methode zur Umgehung von Detektoren besteht darin, die statistische Signatur der KI aktiv zu stören. Dies wird durch die gezielte Erhöhung von Perplexity und Burstiness erreicht.

Vermeidung von KI-Stereotypen:

Bestimmte Begriffe und Phrasen wirken wie „Trigger“ für Detektoren. Wörter wie „delve into“, „it is pivotal to“, „comprehensive“ oder „in the realm of“ werden überproportional häufig von Modellen wie GPT-4 verwendet. Die bewusste Ersetzung dieser Begriffe durch informellere oder spezifischere Alternativen reduziert den KI-Score signifikant.

Strukturelle Disruption:

Das manuelle Einfügen von rhetorischen Fragen, Gedankenstrichen oder kurzen, fragmentierten Sätzen bricht die monotone Rhythmik der KI auf. Ein Text, der bewusst mit der Erwartungshaltung des Lesers spielt, erzielt höhere Perplexity-Werte und wirkt für Filter authentischer.

Anekdotische Evidenz und Kontext:

KI-Modelle können zwar Informationen zusammenfassen, aber keine persönlichen Erlebnisse oder spezifischen, zeitgebundenen Kontext liefern. Die Integration einer persönlichen Geschichte oder eines aktuellen Ereignisses („Wie ich gestern in der Konferenz in Berlin feststellte…“) verankert die Nachricht in der Realität und macht sie für rein statistische Detektoren schwer fassbar.

Fortgeschrittenes Prompt-Engineering

Die Qualität des Outputs wird maßgeblich durch die Präzision des Inputs bestimmt. Vage Prompts führen zu generischen, leicht erkennbaren Ergebnissen.

Ein optimierter Prompt sollte eine klare Rolle, ein spezifisches Ziel und strukturelle Einschränkungen enthalten.

| Prompt-Element | Funktion | Beispiel |

|---|---|---|

| Persona-Zuweisung | Definiert Tonfall und Fachvokabular | „Schreibe als erfahrener Sicherheitsanalyst mit einem Hang zu prägnanter Sprache.“ |

| Zielgruppenfokus | Passt die Komplexität und Empathie an | „Richte dich an technische Leiter, die wenig Zeit für Marketing-Floskeln haben.“ |

| Negative Constraints | Schließt Detektions-Trigger aus | „Vermeide Begriffe wie ‚revolutionär‘, ‚pivotal‘ und nutze keine Sätze über 15 Wörter.“ |

| Strukturelle Vorgaben | Erzwingt Burstiness | „Verwende einen Mix aus sehr kurzen und komplexen Sätzen.“ |

Durch Techniken wie Few-Shot Prompting, bei dem dem Modell mehrere Beispiele des eigenen, menschlichen Schreibstils vorgegeben werden, kann die KI lernen, die individuellen Nuancen des Absenders zu imitieren, was die statistische Abweichung minimiert.

Technisches Fundament und Reputationsaufbau

Keine noch so gute Inhaltsoptimierung kann eine mangelhafte technische Infrastruktur kompensieren. Moderne Filter priorisieren die Absenderidentität vor der Inhaltsanalyse.

Authentifizierungs-Hygiene:

Das korrekte Setup von SPF, DKIM und DMARC ist die Eintrittskarte in den Posteingang. Besonders wichtig ist die Ausrichtung ( Alignment ) der Identitäten, um als vertrauenswürdiger Absender zu gelten.

Domain-Warming:

Neue Domänen werden von Providern wie Google und Microsoft mit äußerstem Misstrauen behandelt. Ein KI-gestütztes „Warming“-Verfahren, bei dem das Versandvolumen über Wochen schrittweise gesteigert wird, während gleichzeitig positive Interaktionen (Öffnen, Antworten, Markieren als wichtig) simuliert werden, ist essenziell für den Aufbau einer positiven Reputation.

Monitoring-Tools:

Die Nutzung von Google Postmaster Tools und Microsoft Defender Threat Explorer bietet tiefen Einblick in die Wahrnehmung des Absenders durch den Provider. Diese Tools zeigen an, wenn eine Domäne aufgrund von Inhaltsmustern oder Reputationsabfällen blockiert wird, noch bevor die Kampagne vollständig scheitert.

Spezialisierte Abwehrsysteme und die „Black Box“ der Filterung

Im B2B-Umfeld haben sich spezialisierte Sicherheitsplattformen wie Proofpoint, Ironscales und Microsoft Defender for Office 365 etabliert, die über die Standard-Filter von Gmail oder Outlook hinausgehen.

Diese Systeme nutzen „Agentic AI“, um Bedrohungen proaktiv zu jagen.

Proofpoint Nexus und die mehrschichtige Analyse

Proofpoint setzt auf eine Architektur namens Nexus, die verschiedene spezialisierte KI-Engines kombiniert, um den Kontext einer Nachricht vollständig zu erfassen.

- Nexus LM (Language Model): Speziell auf die Erkennung von BEC und Phishing-Sprachmustern trainiert.

- Nexus RG (Relationship Graph): Analysiert das Kommunikationsnetzwerk zwischen Absender und Empfänger, um Anomalien im Verhalten zu identifizieren.

- Nexus CV (Computer Vision): Erkennt bösartige Inhalte in visuellen Elementen wie QR-Codes oder gefälschten Login-Seiten, die für Textfilter unsichtbar sind.

Diese Systeme zeichnen sich dadurch aus, dass sie nicht nur die Nachricht an sich bewerten, sondern sie in den größeren Kontext der globalen Bedrohungslage einbetten.

Wenn beispielsweise ein neuer Absender innerhalb kurzer Zeit Tausende von Nachrichten mit einem ähnlichen KI-Profil versendet, wird dies systemübergreifend blockiert.

Die Herausforderung des Shadow Blockings

Ein wachsendes Problem für legitime Absender ist das sogenannte „Shadow Blocking“ oder die „stille Ablehnung“.

Dabei wird eine E-Mail vom Server des Empfängers angenommen ( SMTP 250 OK ), aber anschließend intern gelöscht oder in einem unsichtbaren Quarantänebereich isoliert, ohne den Absender oder Empfänger zu benachrichtigen.

Dies geschieht oft dann, wenn die Inhaltsanalyse eine sehr hohe Wahrscheinlichkeit für KI-generierten Spam ergibt, die technische Reputation des Absenders aber (noch) nicht für eine harte Ablehnung ausreicht.

Die einzige Strategie gegen dieses „Black Box“-Verhalten ist die kontinuierliche Validierung der Zustellbarkeit über Test-Postfächer ( Seed-Listen ) und die strikte Einhaltung der Engagement-Metriken.

Fazit und strategische Prognose

Die Landschaft der E-Mail-Filterung hat sich zu einem hochdynamischen Feld entwickelt, in dem neuronale Netzwerke gegen generative Modelle antreten.

Die Analyse der aktuellen Trends und Technologien führt zu folgenden Schlussfolgerungen für die Optimierung und Zustellbarkeit:

- Die Inhaltsklassifizierung durch NLP und Transformer-Modelle wie RETVec hat die Ära der einfachen Keyword-Umgehung beendet. Absender müssen verstehen, dass ihre Nachrichten semantisch dekonstruiert werden. Erfolg hat nur, wer Authentizität nicht nur behauptet, sondern durch statistische Varianz und kontextuelle Tiefe beweist.

- Die Optimierung von KI-Inhalten darf nicht bei der reinen Texterstellung stehen bleiben. Es bedarf einer synergetischen Verbindung aus strategischem Prompt-Engineering, das Detektionsmuster antizipiert, und einer menschlichen Redaktion, die den „letzten Schliff“ an Individualität verleiht. Die mathematischen Metriken Perplexity und Burstiness müssen dabei als Leitplanken für die Textgestaltung dienen.

- In einer Welt, in der KI-Inhalte allgegenwärtig sind, wird die technische Reputation des Absenders zum ultimativen Filter. Die Einhaltung von Authentifizierungsstandards wie DMARC und der Aufbau von Vertrauen durch kontrolliertes Domain-Warming sind wichtiger denn je. Die Zukunft der E-Mail-Sicherheit liegt in der agentischen Verteidigung, die in der Lage ist, Bedrohungen in Echtzeit zu erkennen und zu neutralisieren, was von Absendern eine ständige Anpassung ihrer Strategien erfordert.

Wer diese komplexen Mechanismen versteht und sie durch eine Kombination aus technischer Exzellenz und linguistischer Raffinesse navigiert, wird auch in einer durch KI-Detektoren geprägten Umgebung eine hohe Reichweite und Akzeptanz seiner Kommunikation erzielen.